Yapay zeka hayatımızda gittikçe daha çok yer almaya başladı. Sağlık, hukuk, eğitim, emniyet, sosyal medya, bilişim gibi pek çok farklı alan karşımıza çıkmaya başlayan yapay zeka algoritmaları bir yandan hayatımızı kolaylaştırsa da, bir yanda da bazı endişeleri beraberinde getiriyor. Bu endişeler arasındaki en güçlü olanı ise insanlar arasındaki çeşitliliğin bu algoritmalar tarafından göz ardı ediliyor olması.İnternet dünyasında neleri beğendiğimizden tutun, bir suçu teşvik etme ya da suça maruz kalma olasılığımızla ilgili yargılara kadar her şeyi bu algoritmalar belirleyebiliyor. İşte bu noktada algoritmaların çeşitliliğimizi göz ardı ediyor olması pek çok soruna yol açabilir.

İsterseniz hemen bu çeşitliliği birlikte test edelim. Gelin birlikte Google’a eyes ( İngilizce göz) yazalım. Çıkan gözlerin pek çok ortak yönü var değil mi? Beyaz tenli insanlara ait bu gözler arasında hiç çekik gözlü yok. Anlayacağınız üzere algoritmalar pek çok sonuç bulma da başarılı ancak bu sonuçları çeşitlendirme konusunda sıkıntı yaşıyor.

Yapay Zeka Irkçı Mı?

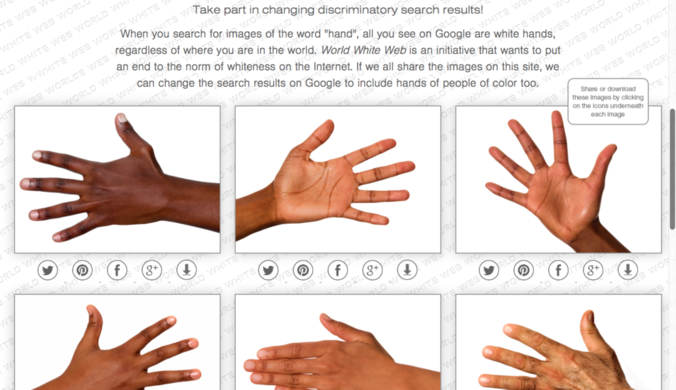

Grafik tasarımcısı Johanna Burai ise bu konuya dikkat çekmek isteyen bir isim. Bir çeşitlilik yaratmak adına bir internet sitesi kurma yolunu seçen Burai, Google aramalarında karşılaştığı sonuçların ağırlık olarak beyaz olması üzerine, ‘World White Web Project’ adlı internet sitesini kurdu. Sitede pek çok farklı insanı eli resmi bulunuyor. Farklı ırklardan insanların ellerinin bulunduğu internet sitesiyle Burai içerik arayanlar için bir alternatif yaratmak istemiş.

Üstelik Burai başarılı da olmuş. Dediğini göre yaptığı çalışmaya olan ilgi oldukça olumlu.

‘İnsanlar sorunu görmeye başladılar. Projeye ilk başladığımda, insanlar şok içindeydi.’

Google ise kendisine yöneltilen eleştirilere karşı verdiği cevapta, görsel arama sonuçlarının kendi değerleriyle ilgisi olmadığını savunuyor. Google yetkilileri, arama sonuçlarının internetteki içeriklerde ne tür görsellerin daha çok kullanıldığı ve internette bu görsellerin nasıl tanımlandıklarını yansıttığını belirtiyor.

Algoritma Adaleti Mümkün!

Burai algoritmaların daha adaletli bir şekilde işlemesi için çalışan tek isim değil. Algoritmalarda adaletin sağlanması amacıyla kurulan Algorithmic Justice League (Algoritma Adalet Ligi) de, bu konudaki farkındalığın en iyi örneklerinden.

Bu inisiyatifin kurucusu olan Joy Buolamwini, ABD’nin tanınmış üniversitelerinden Massachusetts Institute of Technology’de (MIT) doktora öğrencisi. Üstelik o bir algoritma mağduru.Bir yüz tanıma programı ten renginden dolayı onu tanıyamadığı için, bu projeyi başlatmış Boulamwini. Yapay zeka yüzünü tanımadığı için, beyaz maske kullanmaya başlayan genç girişimci, bundan 5 yıl önce de, teni daha açık olan oda arkadaşından yardım isteyerek bu sorunu çözüyormuş.

‘Çok karışık hisler içindeydim. Hem bu sorunun beş yıldır halen devam ediyor olması karşısında kızıyordum, hem de beyaz maskenin bu kadar işe yaraması bana eğlenceli geliyordu.’

Örneğin bir tıp araştırmacısı, AJL’ye danışarak cilt kanserini tanıyan bir algoritmanın siyahlarda çalışıp çalışmadığını görmek istemiş. Aşırı kilo ya da obezitesi olanlar ile yaşlılara yönelik yapay zeka teknolojilerinin nasıl çalıştığı da, Buolamwini için merak konusu.

Microsoft Çalışanlarının %17’si Kadın, %2.7’si Siyah

Boulamwini’ye göre, algoritmalardaki sorunun bir kaynağı da, teknoloji endüstrisinde çalışanlar arasındaki çeşitlilik eksikliği. Dev teknoloji şirketlerinin her yıl yayınladığı ‘çeşitlilik raporları’ bu durumu kanıtlar nitelikte:

*Google’ın Ocak 2016’da paylaşılan son raporunda, şirketteki teknik departmanlarda çalışanların sadece yüzde 19’unun kadın olduğu, yüzde 1’inin de siyahlardan oluştuğu görülüyor.

*Microsoft’un Eylül 2016’daki raporuna göre, bu çalışanların yüzde 17.5’i kadın ve yüzde 2.7’si siyah ya da Afrikalı Amerikalı.

*Facebook’un Haziran 2016’da yayınladığı raporda ise, ABD departmanının yüzde 17’sinin kadın ve yüzde 1’inin de siyahlardan oluştuğu belirtilmiş.

*100 ülkede çekilen 6 bin selfie (özçekim) üzerinden geçen sene algoritmaların seçtiği güzellik yarışmasında kazanan 44 kişiden sadece birisi beyaz değildi ve az sayıda Asyalı vardı.

Bu konuda yapılan bir başka araştırma ise Amerika’da suçluların tespit edilmesi için kullanılan yapay zekanın, beyazlara oranla siyahların suçlarla bağlantılı olması riskini daha fazla olarak hesapladığını ortaya koyuyor. Uzmanlara göre, dünya değişirken karar mekanizmalarındaki taraflılık ve önyargılar, ileride muğlak doğru olarak görülecek ve bu durumun farkında bile olmayacağız.

Peki Ne Yapılmalı?

Uzmanlar bu sorunun çözülmesi için 3 farklı yöntemin izlenebileceğini vurguluyor.

*Algoritmaları ‘eğitmek’ için daha çeşitli veri tabanları üretmek

*Yazılım ve program satıcıları arasında bu alışkanlığı yaygınlaştırmak

*Algoritmaları, karar verme süreçlerindeki önyargılarla ilgili kullanıcıları bilgilendirecek şekilde kurmak.

Üstelik bu yöntemlerin geliştirilmesi ve bir an önce uygulanmaya başlanılması şart. Çünkü şu an geliştirilen yapay zekalar, gelecekte hayatımızın her alanında olacağı varsayılan robotların ilham kaynağı olacak. Bu neden önyargılı robotların geliştirilmesinin önüne geçilmesi oldukça büyük önem taşıyor.